根据IDC的《全球服务器季度追踪报告》,2024年第四季度全球服务器市场收入创下新高,达到773亿美元(约合5595亿元人民币),同比增长91%,成为2019年以来增速第二高的季度。

继续阅读

Google AI TPU

根据IDC的《全球服务器季度追踪报告》,2024年第四季度全球服务器市场收入创下新高,达到773亿美元(约合5595亿元人民币),同比增长91%,成为2019年以来增速第二高的季度。

继续阅读

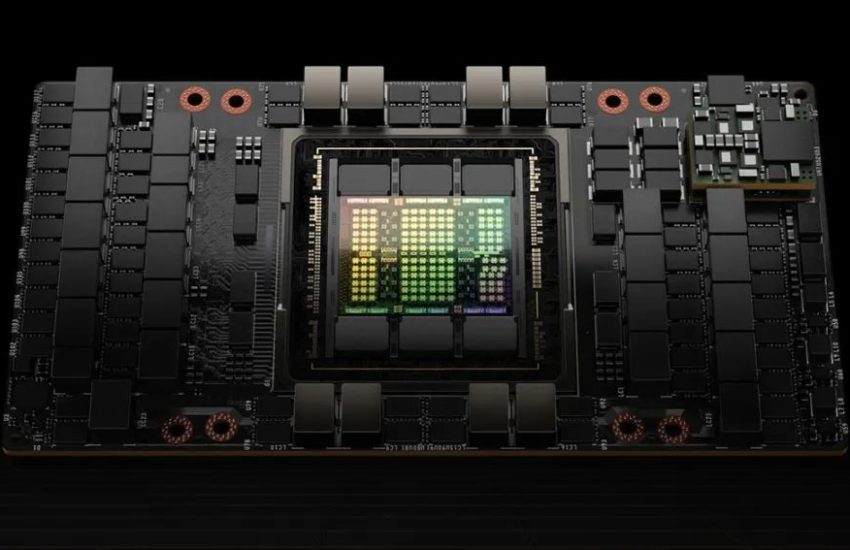

2024年,数据中心市场,英伟达显卡依然一卡难求,已发布的A100、H100,L40S,还有即将发布的H200都是市场上的香饽饽。

继续阅读

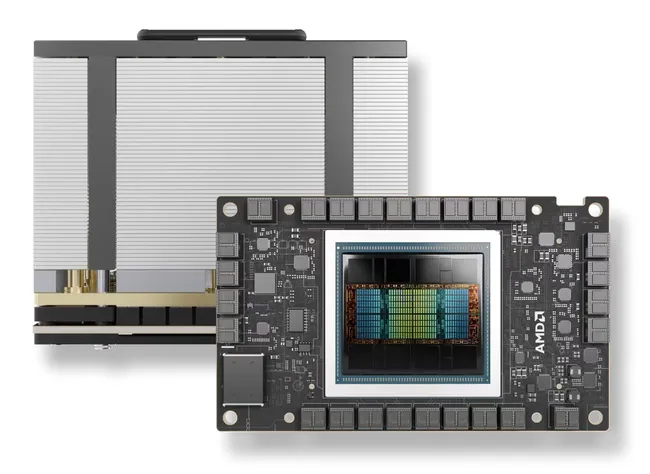

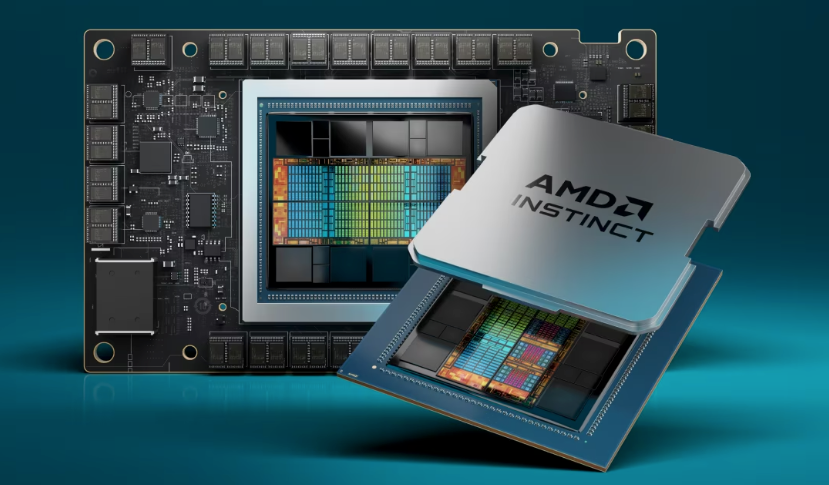

AMD于今年 12 月初发布了MI300X 图形加速器,声称比 Nvidia 的 H100 领先 1.6 倍。

继续阅读

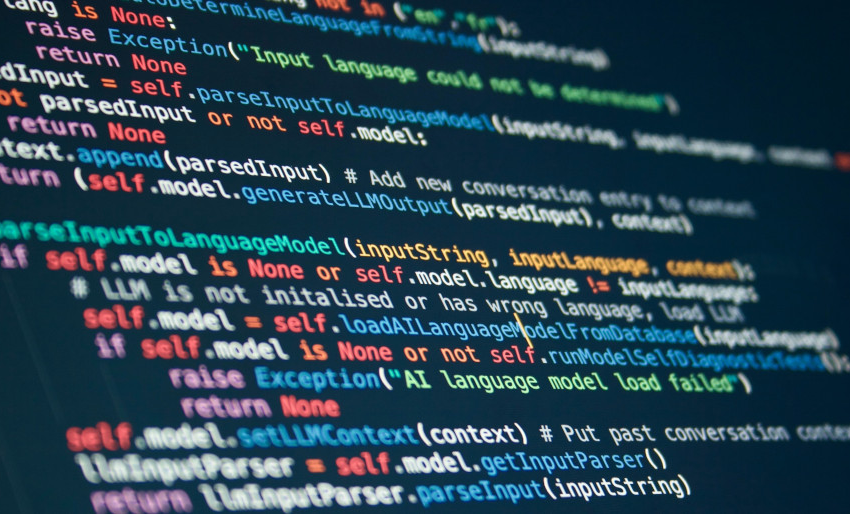

加速深度学习模型的训练和推理过程对于充分发挥其潜力至关重要,而NVIDIA GPU在这方面已经成为改变游戏规则的技术。

继续阅读

AMD 今天宣布推出期待已久的 MI300X 加速器芯片,AMD 打算成为 NVIDIA 旗舰 H100 GPU 的有力竞争对手。

继续阅读

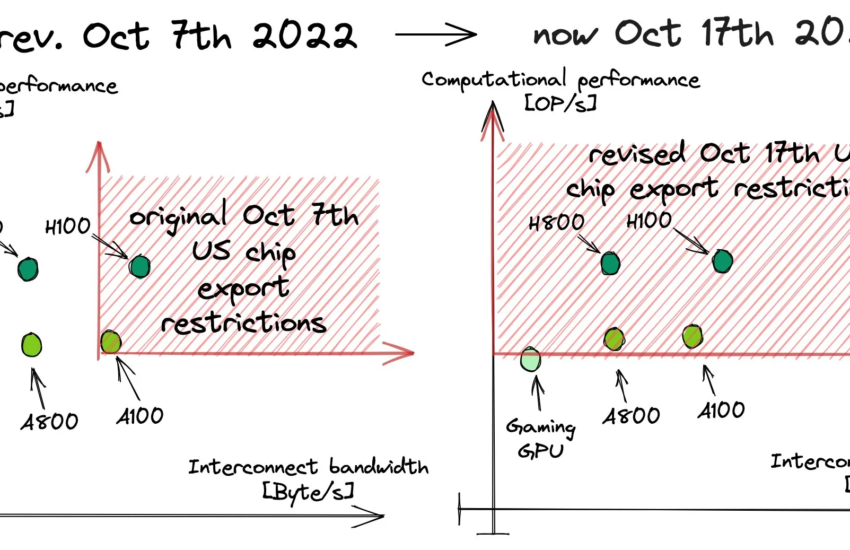

美国政府对21世纪的“冷战”发动了最新的回击,涵盖了AI芯片和晶圆制造设备。

继续阅读

IBM的“北极”NorthPole是一种类脑芯片,我们需要先了解什么是类脑芯片。

继续阅读

全球范围内的服务器和存储支出似乎主要来自于AI基础设施支出,而用于其它工作负载的数据中心设备的基础支出甚至比年初还要疲弱。

继续阅读

在Google I/O 2023活动中,Google软件产品组合中的生成式AI功能成为焦点,这一点毫不奇怪。

继续阅读