在数据中心和大型高性能计算环境中,服务器散热是维持系统稳定性和效率的关键。随着处理器速度的提升和高性能计算的需求增加,服务器功率增加产生的热量也在持续增加。有效的散热系统不仅能提高服务器性能,还能降低能耗,节省大量费用,减少对环境的影响。

散热的重要性

服务器在处理大量计算任务时会产生大量热量。如果热量不能有效散发,会导致硬件性能大幅下降甚至损坏。因此,合理的散热方案对于保障服务器的持续运行至关重要。

散热系统的设计考量

服务器的散热设计需要考虑多个因素,包括:

- 热负载:即服务器在全负荷运行时产生的热量。热负载越高,散热系统的设计就需要越复杂。

- 空气流动:散热系统的设计必须保证空气能够有效流过热敏感组件,带走热量。

- 环境温度:服务器所在环境的温度也会影响散热效率,因此散热系统需要能在预期的温度范围内有效工作。比如很多数据中心建设到贵州,就是因为环境温度比较合适,有利于降低散热的能耗和复杂度

散热技术的分类

服务器散热技术主要分为两类:主动散热和被动散热。

- 主动散热:使用风扇、冷却液泵等设备,强制将热量从热源传递到外部环境中。这是最常见的散热方式,特别是在标准的机架式服务器中。

- 被动散热:依赖于散热器的热导性能和自然对流,无需使用额外的能源。这种方式常用于空间受限或需要静音操作的环境。

散热技术的介绍

随着技术的发展和场景应用的需求。散热技术也在不断进步:

液体冷却系统:液体冷却系统通过将冷却液直接流过热源,以高效率散热。这种系统通常用于高性能计算服务器,特别是GPU密集型的服务器。液体冷却能提供比传统风扇更低的温度,从而保证处理器可以在更高的频率下运行。例如,谷歌的数据中心就采用了先进的液体冷却技术,通过海水进行冷却。Facebook的数据中心则利用了自然环境的冷却效果,通过建在温度较低的地区,使得服务器能够利用自然风进行冷却。

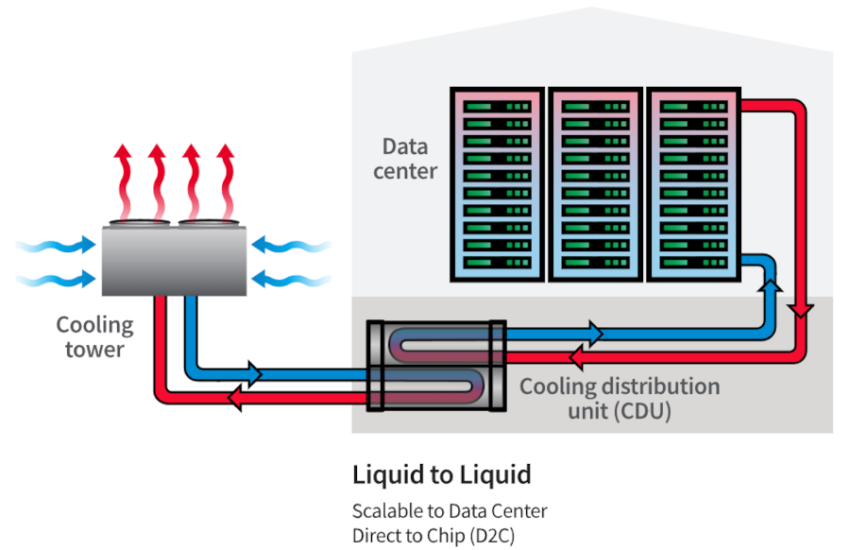

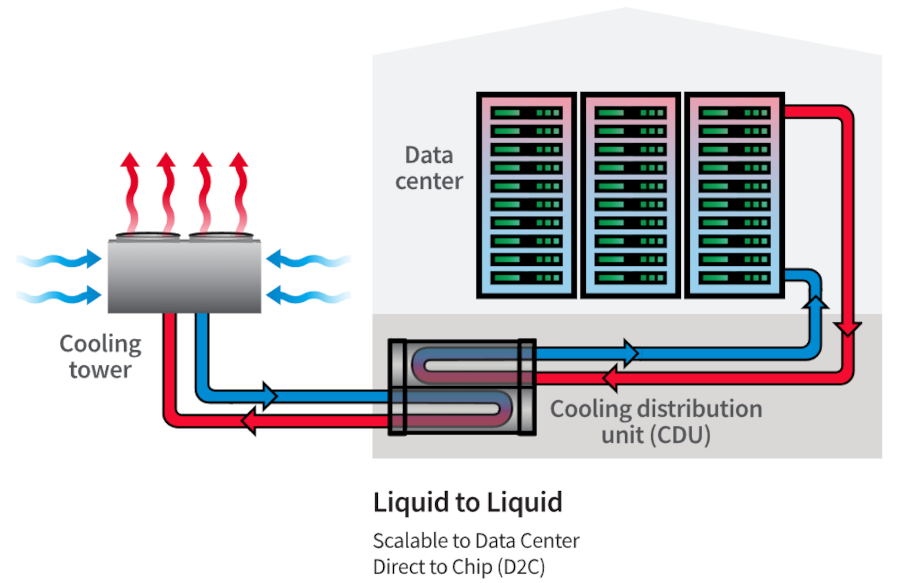

液体to液体冷却

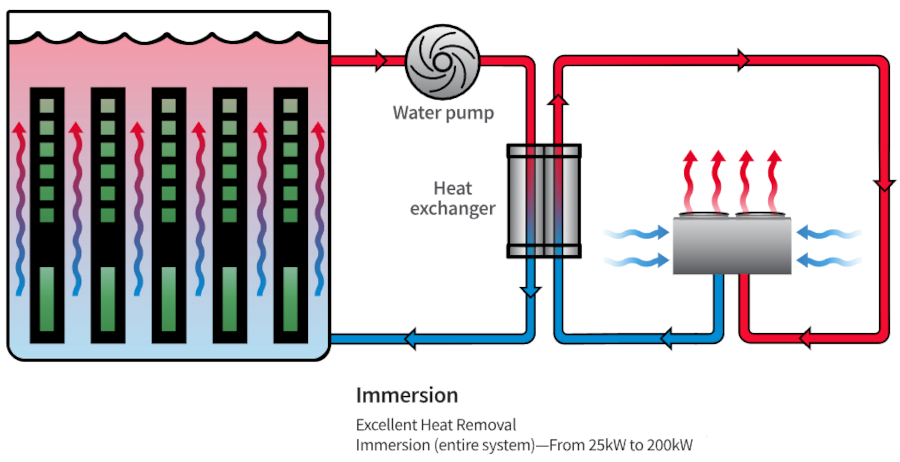

浸没式液冷

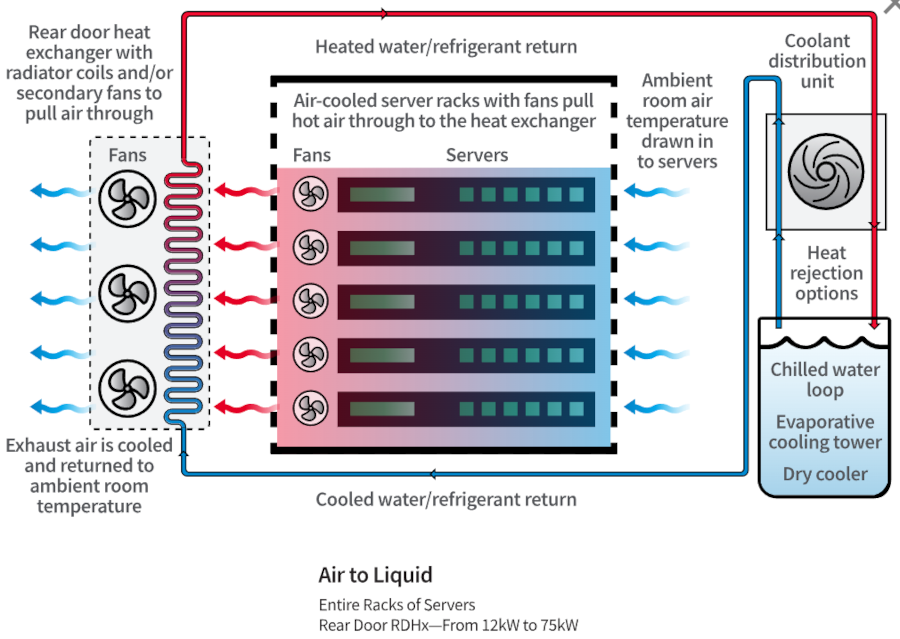

气体to液体冷却

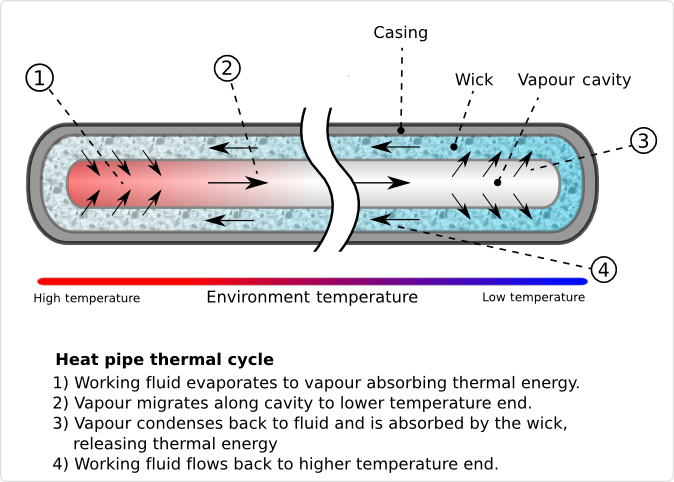

热管技术:热管是一种高效的热传导设备,它可以迅速将热量从热源(如CPU)传输到冷却器(如散热片或散热器)。热管的工作原理基于液体的蒸发和凝结循环过程:

- 热管内部填充有工作液体,一端接触热源。

- 热源的热量使工作液体蒸发成蒸汽,蒸汽带走大量热量。

- 蒸汽在热管内流动到较冷的一端(冷凝区),释放热量并凝结回液体。

- 凝结的液体通过毛细作用或重力返回到热源端,循环重新开始。

热管的传热效率非常高,因此在需要高性能散热的场合被广泛使用。

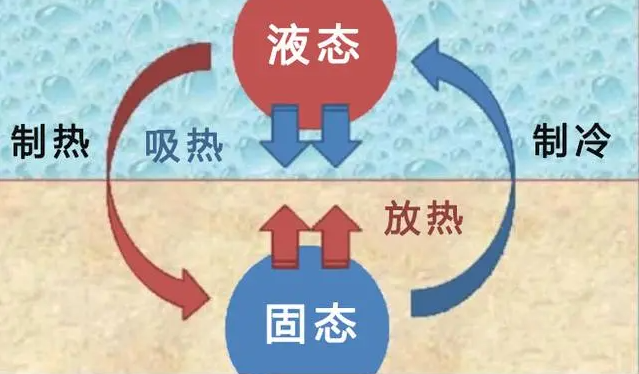

相变材料冷却技术:相变材料在吸收或释放热量时会发生物理状态的改变,比如从固态变为液态或从液态变为气态。在散热过程中,相变材料可以吸收大量的热量而只有微小的温度变化,这种性质使得它们成为优秀的热缓冲材料。

- 当设备运行时,产生的热量会被相变材料吸收,材料从固态变成液态。

- 当设备关闭或散热时,材料开始释放热量并从液态回到固态。

- 这个循环过程可以不断重复,从而维持设备在一个相对恒定的温度范围内运行。

相变材料冷却技术适合于需要处理瞬间高热负荷或在温度控制非常严格的应用中。

风扇技术的优化:高效的风扇能在更低的噪音水平下提供更好的气流,例如采用磁悬浮技术的风扇就能降低摩擦,减少噪音并提高效率。

最后

在考虑散热方案时,不仅要考虑其效率和成本,还要关注其对环境的影响。一个好的散热方案,应该是高效、经济、环保的。