NVIDIA GH200 的独特之处在于其CPU与GPU的集成方式。它包含72个基于Arm v9架构的内核(Neoverse V2),并通过高速的NVLink-C2C接口将CPU与GPU紧密相连,提供了极高的带宽和性能。

继续阅读

Google AI TPU

随着时代快速发展的人工智能,已然成为引领新一轮科技革命和产业变革的核心驱动力,并全面深刻地改变着人类的生产和生活方式。

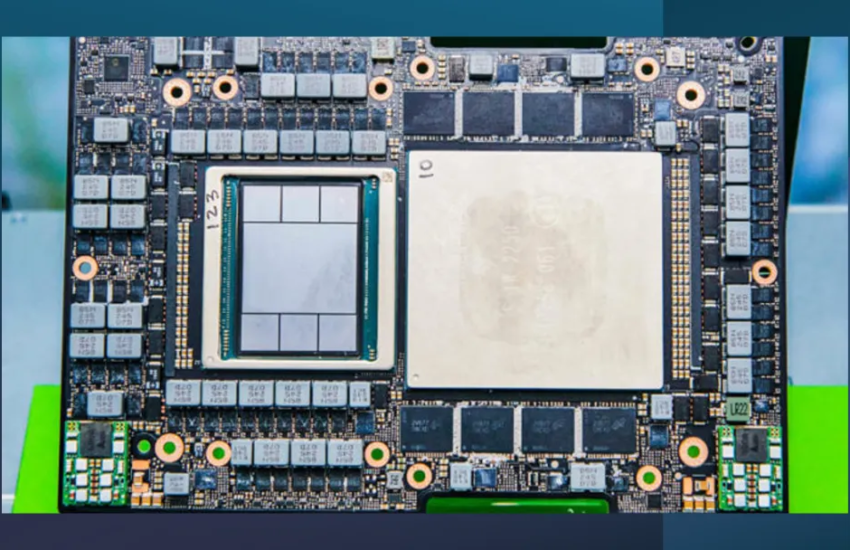

NVIDIA GH200 的独特之处在于其CPU与GPU的集成方式。它包含72个基于Arm v9架构的内核(Neoverse V2),并通过高速的NVLink-C2C接口将CPU与GPU紧密相连,提供了极高的带宽和性能。

继续阅读

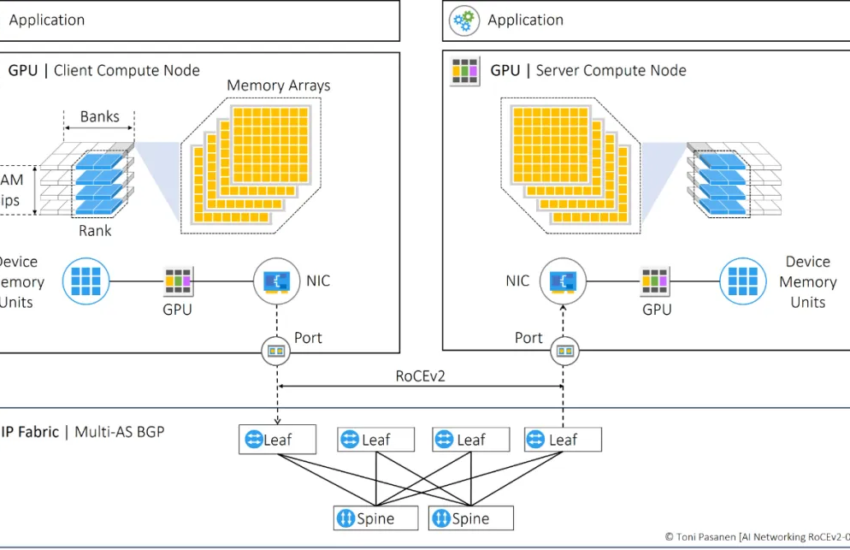

RDMA (Remote Direct Memory Access,远程直接内存访问) 架构可在高性能计算 (HPC) 环境中实现计算节点 (CN) 之间的高效数据传输。RDMA over Converged Ethernet version 2 (RoCEv2)利用路由IP Fabric作为RDMA消息的传输网络。

继续阅读

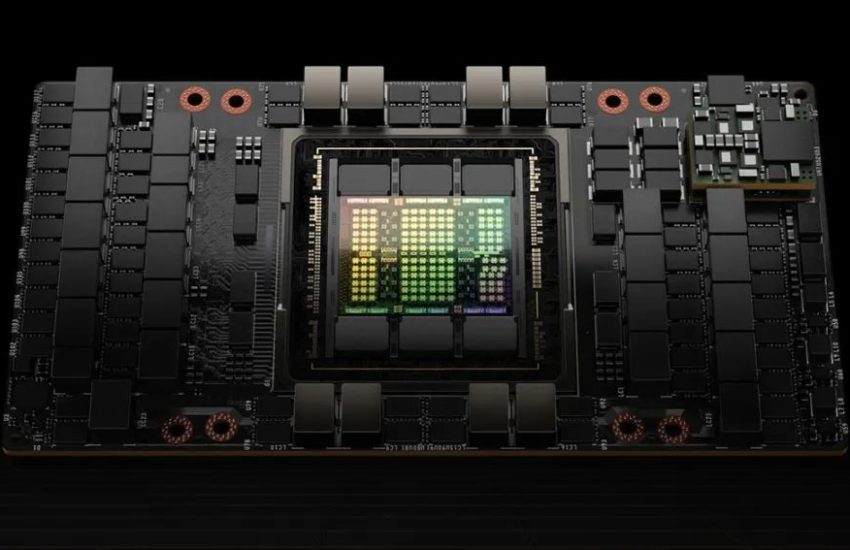

2024年,数据中心市场,英伟达显卡依然一卡难求,已发布的A100、H100,L40S,还有即将发布的H200都是市场上的香饽饽。

继续阅读

高管和董事层展现出浓厚兴趣,成果明确,且应用速度之快,使得生成式AI(GenAI)成为前所未有的存在。

继续阅读

人工智能、机器学习、量子计算,这些曾经只存在于科幻作品中的技术如今正在塑造智能创新的新时代,其发展速度超出了任何人的想象。

继续阅读

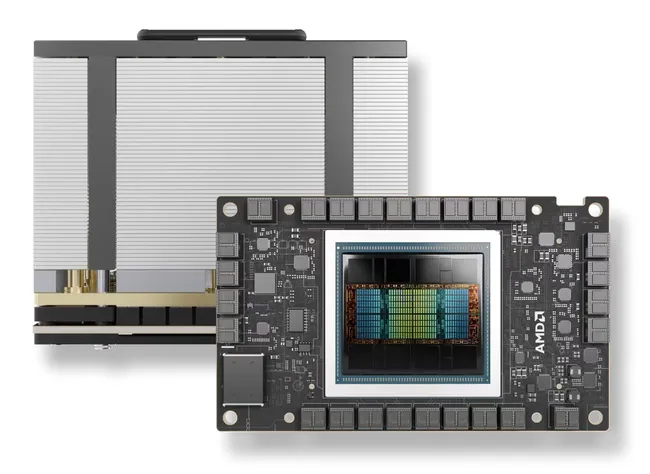

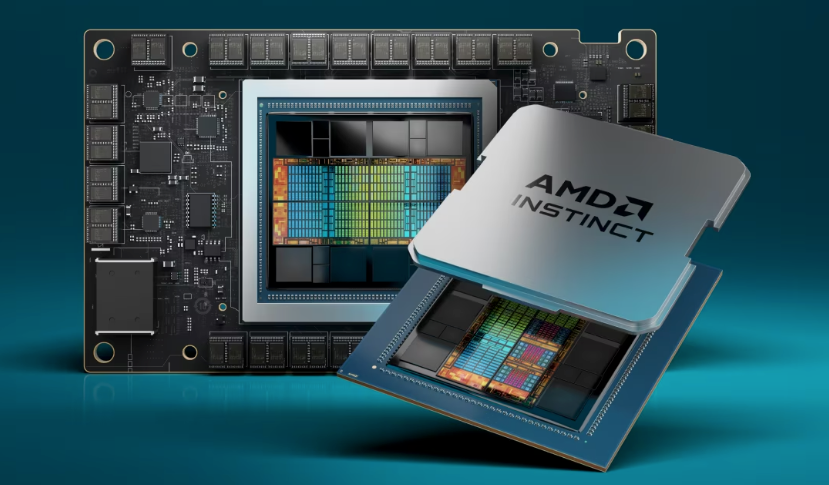

AMD于今年 12 月初发布了MI300X 图形加速器,声称比 Nvidia 的 H100 领先 1.6 倍。

继续阅读

以下是我对英特尔周四在纽约举行的“AI无处不在”(AI Everywhere)活动的总结。

继续阅读

加速深度学习模型的训练和推理过程对于充分发挥其潜力至关重要,而NVIDIA GPU在这方面已经成为改变游戏规则的技术。

继续阅读

HBM全称为High Bandwidth Memory,直接翻译即是高带宽内存,是一款新型的CPU/GPU内存芯片。

继续阅读

AMD 今天宣布推出期待已久的 MI300X 加速器芯片,AMD 打算成为 NVIDIA 旗舰 H100 GPU 的有力竞争对手。

继续阅读