在AI领域,硬件和存储方面的演进至关重要。新兴存储系统满足了AI需求的关键要求,如高吞吐量、低延迟、可扩展性、并行性等,同时采用数据缩减、压缩和智能数据放置技术,以提高性能和效率。尽管初期投资较高,但AI基础设施的投资可以带来长期的成本节省和收入增长,使AI技术对各种规模的组织都更加可访问和高成本效益,随着更多计算平台和供应商的涌现,AI将继续扩大其影响力。

在数据急剧增长和技术飞速进步的时代,AI崭露头角,已成为全球各行各业的变革动力。AI具有解锁宝贵洞察力和提高效率的潜力,因此企业正在不断增加对AI基础设施的投资,以发挥其潜力。Lenovo AI业务负责人Robert Daigle接受采访时指出:“通过推动生成式AI技术并在金融、制造、医疗、零售和智慧城市等领域实现认知决策,AI正引领着深刻的变革。”

随着AI逐渐成为各行业的不可或缺部分,对于成本效益高且可扩展的AI基础设施需求不断增加。硬件制造商正在积极开发定制解决方案以满足这一需求。

AI硬件格局演进

“数据科学家和AI从业者花费超过77%的时间在数据预处理、训练、建模和调优任务上,” Daigle解释道。“这一工作流程对于强大的处理器(核心数量和时钟速度)、内存和GPU性能有着巨大需求。”像Lenovo、Dell和HPE等硬件制造商正专注于提供经过优化的系统,以应对处理AI工作负载的需要,使工程师和数据科学家能够从庞大的数据集中提取宝贵的洞察力。这些系统采用强大的CPU和GPU来进行AI推理,从而实现高效的实时决策,并包括强大的服务器和高性能存储系统。

AI硬件领域不仅局限于传统的原始设备制造商(OEM)。云服务商,如AWS、Microsoft Azure和Google Cloud,也在积极开发专注于AI的硬件解决方案。例如,AWS推出了Inferentia,这是一款专为机器学习模型推理而设计的高性能、经济实惠的AI推理芯片,而Google的Tensor Processing Units(TPU)则是专为推理和训练任务而打造的定制AI加速器。这些举措表明了AI硬件领域的不断演进和创新。

AI增强型存储

AI增强型存储系统专门经过设计和优化,以满足AI工作负载的独特需求,这些工作负载通常包括大规模数据集、高吞吐量数据访问以及复杂的数据处理。这些存储系统旨在提供必要的性能、可扩展性和可靠性,以满足AI应用的要求。AI增强型存储系统在以下方面对AI工作负载进行了优化:

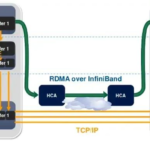

数据吞吐量和带宽:AI工作负载通常涉及需要快速处理的大型数据集。AI存储系统的设计具备高数据吞吐量和带宽能力,以有效地在存储设备和AI处理单元(如GPU或TPU)之间传输数据,确保数据以最大化计算效率的速率输入到AI模型中。

低延迟:减少数据访问延迟对于AI应用至关重要,特别是在实时或交互式场景中。AI存储系统经过优化,以最小化读写延迟,以实现快速数据检索和存储。

可扩展性:AI项目通常需要大量的数据存储,存储系统必须能够轻松扩展以容纳不断增长的数据集。AI增强型存储解决方案旨在在容量和性能方面都能够扩展,以满足不断增加的需求。

并行性:AI工作负载可以高度并行化,而专为AI优化的存储系统利用了这一特点。它们的设计支持多个AI处理单元的并发数据访问,从而实现AI算法的高效并行处理。

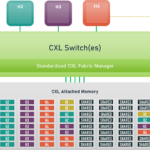

数据管理和分层:AI存储系统可能采用智能数据管理技术和分层策略。经常访问的数据或需要立即处理的数据可以存储在高性能存储层上,而不经常使用的数据可以存储在成本较低、容量较大的存储层上。这种分层方法有助于平衡性能和成本效益。

数据缩减和压缩:AI模型通常需要大量的数据,存储系统可能采用数据缩减和压缩技术,以最小化存储占用空间同时保持数据完整性。这些技术可以节省存储空间并潜在地提高数据访问速度。

AI感知数据放置:一些AI增强型存储系统使用AI算法分析数据访问模式,并智能地将数据放置在最需要的处理单元附近。这可以减少存储基础设施上的数据移动,并进一步提高性能。

数据安全和隐私:由于AI工作负载通常涉及敏感数据,因此AI存储系统优先考虑数据安全和隐私措施,包括加密、访问控制以及遵守相关数据保护法规。

与AI框架集成:AI存储解决方案可能提供与流行的AI框架和库的集成,从而使数据科学家和AI开发人员能够与存储基础设施无缝协作。

AI基础设施投资

AI基础设施为工程师和数据科学家提供了前所未有的数据处理和分析速度,促进了及时决策和创新。将AI基础设施融入组织的技术体系需要精心策划,特别是在预算方面。

随着AI逐渐成为业务运营不可或缺的一部分,企业需要重新审视其硬件预算策略,以适应AI需求的增长。尽管与传统的计算基础设施相比,AI硬件可能需要更高的初期投入成本,但从长远来看,它的好处可能会超过最初的投资。通过提高运营效率、加速洞察力的获得以及推动创新,AI基础设施投资可以在长期内实现显著的成本节省和收入增长。

数据呈指数级增长,AI具有革命性的潜力,这要求全面投资于AI基础设施。Daigle表示:“更多的计算平台选择和不断扩大的GPU和加速器供应商生态系统将有助于使AI对各种规模的组织都变得更加可访问和高成本效益。”